近年来,大型语言模型(LLMs)的快速发展极大地提升了机器学习系统处理语言与知识的能力。然而,当LLMs从文本扩展到语音输入时,其性能往往不及基于文本的模型,也常低于基于级联流水线的传统方法。这种性能差距被我们称之为“文本-语音理解差距”,具体指的是语音适配的LLMs在处理语音输入时的表现相较于原始文本模型处理等效文本时的性能下降。该差距仍然是多模态学习领域的关键挑战之一。

目前,缩小这一差距的常见方法主要依赖于两类策略:一是大规模生成语音合成文本数据,这种方法成本高昂且高度依赖合成数据;二是使用大型专有语音数据集,这种方法缺乏可复现性。为解决这些问题,我们的研究旨在探索一种数据高效的新方法,以缩小文本-语音理解差距。

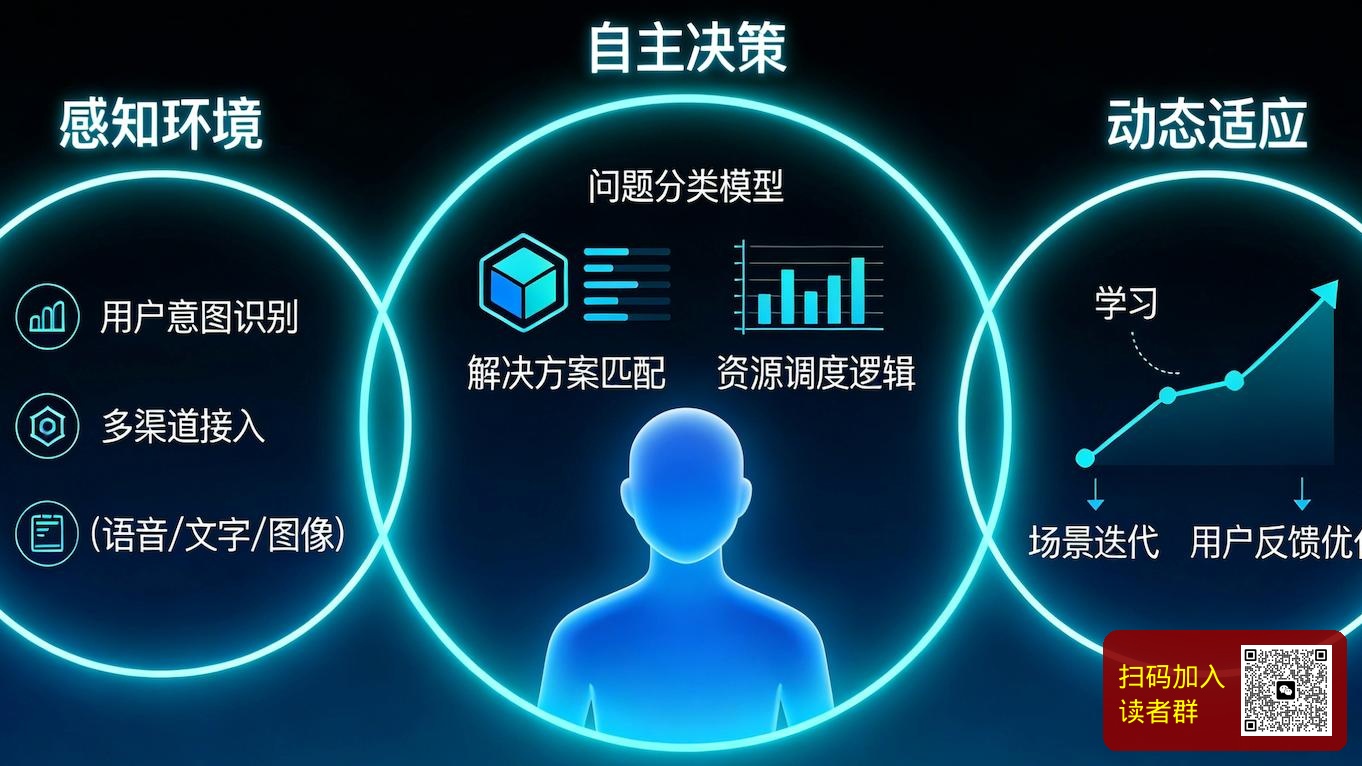

通过深入分析,我们发现文本-语音理解差距主要由两大因素驱动:

1. 适配过程中的文本能力遗忘:语音适配过程中,模型往往丧失其原文本处理能力。

2. 跨模态失配:语音和文本模态之间的对齐不足,导致模型在多模态处理时无法充分利用语音输入。

基于此分析,我们提出了名为SALAD(样本高效对齐,通过主动选择和跨模态蒸馏学习)的新方法。SALAD结合了跨模态蒸馏(cross-modal distillation)和有针对性的语音合成数据策略,在改善语音-文本对齐的同时,有效缓解模型的文本能力遗忘问题。通过这一方法,我们实现了更加数据高效的改进,仅使用数量大幅减少的公开语音数据集即可达到显著性能提升。

我们将SALAD方法应用于3B和7B规模的LLMs,并在知识、语言理解以及推理能力等广域基准测试中评估其表现。结果表明,与强大的开源权重模型相比,SALAD能够在多个领域中实现具备竞争力的性能,同时对数据量的依赖减少了一个数量级以上。这一里程碑式的成果表明,SALAD在提升模型多模态能力方面具有显著潜力。

随着基础模型和LLMs的多模态处理能力不断进步,基于多种输入模态(如语音、文本)的学习系统正在改变人工智能的研究方向。然而,现存的大多数多模态模型主要基于预训练的LLMs构建,这在一定程度上限制了其对其他模态之间时序依赖关系的准确建模能力,并限制了各种模态的联合处理潜力。

SALAD的成功提供了一种新的思路,未来的研究可以更好地整合不同模态间的知识,更高效地利用有限数据,促进基于多模态输入的语言模型进一步发展。

在语音与文本的结合上,SALAD模式不仅为理解多模态数据提供了新的可能性,也为其他研究领域提供了重要启示。未来,通过继续探索类似SALAD的创新方法,我们或许能够进一步填补模态间的差距,推动人工智能在知识整合与语言理解领域的变革发展。

[人形纪元网出品] [多模态学习] [语音文本对齐] [数据高效方法] [文本语音理解差距] [刘智勇频道] [真机智能(zhenrobot.com)] [真机算法] [真机资本(zhencap.com)] [真机宇宙(zhenmeta.com)] [机器姬永生人] [机器洞察网] [AI之星网] [风投高科网] [猛虎财经网] [硅基科学网] [人形纪元网] [真机量化(zhenquant.hk)] [真机内参] [真机尽调(zhendue.com)] [高能判官] [片场狂徒] [暴徒外放] [Cognition OS] [Embodied OS] [黄金广告位]

📚 【精品资源】添加关注『人形纪元网微信公众号』,即可免费获取完整版《刘智勇频道第五卷》

文字和语音的结合能让表达更加丰富生动,多模态或许才是未来AI的最终形态!

看到SALAD成功的案例分析,觉得科技真的是最伟大的魔法!它正在一步步改变我们的世界。

从研究视角看问题,看得出这篇文章作者是真的用心在推动模型落地,为他们点赞。

大型语言模型越发展,越觉得小时候的钢铁侠世界已在不远处,梦想真的可以照进现实!